토마스 베이즈는 1700년대 영국의 목사이자 (아마추어) 수학자 였다고 한다. 토마스 베이즈는 ' 원인->결과 '보다는 ' 결과->원인 '을 알아내보고 싶었던 것 같다. 다만 일반적인 과학자/수학자처럼 상세하게 파헤졌다기보다는 "우리가 관측값만 알고 있을 때, 그 원인을 추론할 수 있는 방법에 대하여"의 논문 한편만을 사후에 프라이스라는 친구가 정리하여 출시하며, 이론만 확립했고 이후 200년까지도 큰 반향은 없었다.

이후 20세기 초에 Pearson, Fisher로 대변되는 '빈도주의(Frequentist)'가 통계학과 경제학의 주류로 부상하며, Bayesian은 사실상 묻히는 듯 했다.

하지만 사후분포를 컴퓨터 등으로 계산할 수 있게되고 나오고, GPU 등의 더 높은 수준의 컴퓨팅 자원들이 나오면서 베이지안도 변곡점을 맞이했다.

베이즈 정리 ( Bayes’ Theorem ) 는 아래와 같다.

대부분 공식은 기본적으로 '원인->결과'의 루트. 즉 상당히 연역적으로 전개된다. A면 반드시 B가 나와야하는 구조이다.

베이즈 정리는 '결과->원인'의 루트에 더 가깝다. 'B가 나왔는데, A 때문일까?' 에 가까운 생각이다. 일반적으로 공식 결과에 필요한 '폐쇄형 해'가 없다.

구어체로 바꾼다면 "원래 그렇게 생각하고 있었는데(Prior), 지금 이런 일이 일어났으니까(Evidence), 그 생각이 맞을 확률을 다시 계산해보자" (Posterior) " 계산할 때는,"그 생각이 맞다고 했을 때 이런 일이 일어날 가능성(Likelihood)"을 곱해서 조정하는 방식이야.

개인적으로는 이미 해당 방식이 연역적인 하나의 강한 Rule이 아니라 언제든지 바뀔 수 있는 MLOps를 이미 내재하고 있는 듯한 느낌도 든다. 새로운 데이터가 인풋되어 Posterior의 영향을 주고 이는 새로운 Prior의 기준이 된다.

위의 공식을 개념적으로 바꾸면 아래와 같다.

P(H) - Prior는 기존의 데이터, 실험, 혹은 주관적인 판단에 의해 정해진다. 도메인 지식이 있거나, 시장 데이터 등도 도움이 될 수 있겠다.

다만 현실에서는 P(E) - Evidence 를 구하기가 실제로 어렵다는 것이다. '모든 경우에 대해 이 증거가 나올 확률'은 사실상 대다수의 태스크에서 확정적으로 알기 어렵다. 다만 이를 극복하기 위해서 MCMC ( Markov Chain Monte Carlo ) 를 사용하여 샘플 데이터를 만든다. 여기서 Markov Chain은 해당 데이터의 분포대로 움직이는 네비게이션 역할을 해주며, Monte Carlo는 무작위로 샘플을 뽑는 역할을 한다. 즉 해당 데이터 분포에 따라 히트맵을 그리며 움직이면서 데이터 샘플을 모아오는데 이것이 MCMC이다. 정규분포라면 상수를 쓰면 되겠지만, 해당 분포에 대한 상수를 알 수 없으니 한땀한땀 데이터를 모아오는 것과 같다.

다만 후술하겠지만 이런 분포를 customize하는 MCMC를 쉽게 대체하기 위해 어느정도 분포모델과 태스크별로 template처럼 공액쌍 ( conjugate pair ) 이 존재한다.

자 이제 P(H)와 P(E) 를 다 아니까 P(E|H)인 우도(Liklihood)는 아주 쉽게 구할 수 있겠다고 생각할 수 있지만, 아쉽게도 그렇지 않다. 우도를 구하기 위해서는 어떤 확률 분포 모델을 사용할 것인지 정해야한다. 그리고 이 확률 분포 모델은 구해야할 태스크에 밀접하게 연관되어 있다.

대표적인 태스크가

이진 분류(binominal)를 한다면 베르누이 분포

기간 및 시간 간격(time / interval time)을 예측한다면 와이블 분포

횟수(count) 예측을 한다면 포아송 분포

등의 확률 질량(밀도) 함수 (PMF/PDF)를 사용할 수 있겠다.

| 질문 예시 | 확률 분포 모델 ( 확률 질량 함수, PMF ) |

| 고객이 구매했나 안했나? | Bernoulli |

| 유저가 며칠 만에 이탈하냐? | Weibull |

| 하루에 몇 번 로그인하냐? | Poisson |

사실 이런 분포들은 기존의 점추정 모델에서도 내재되어 있다. 다만 빈도주의 기반의 모델들이 많이 심화되었기 때문에 내재되어 있는 확률 함수 모델들이 과거보다는 표면적으로 자주 보이지는 않는다.

( ex. 로지스틱스 회귀는 베르누이를 내포하지만 ReLU 등의 딥러닝 레이어에서는 기존 이론들을 다소 생략하고 결과에 집중하는 자체 함수 사용 )

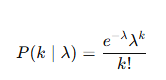

예시는 가장 빈번하게 사용되는 분포 중 하나인 포아송 분포의 PMF이다.

빈도주의는 해당 λ ( lambda ) 의 값을 정확하게 point로 특정한다. 일반적으로 데이터의 평균(기댓값) 등으로 치환해서 구한다. 데이터 양이 이미 많거나 신뢰도가 높다면 빈도주의 방식으로도 충분히 해당 값을 구할 수 있다.

다만 아래와 같은 상황들이 비즈니스 레벨에서는 빈번하다.

1) UserID, SessionID를 key값으로 하는 필연적으로 적은 수의 로그 데이터셋

2) 릴리즈 되지 않았거나 릴리즈 한지 얼마 되지 않은 프로젝트, UI 항목

3) 다양한 행동 가설에 대한 정확한 확률이 필요한 태스크

위의 상황에서는 사실상 '평균'은 큰 의미가 없을 수 있다. 베이지안은 '내가 들고 있는 데이터를 기본적으로 의심하겠다' 라는 생각도 내포하고 있다. 그래서 이 λ ( lambda ) 값을 point가 아닌 분포( distribution ) 를 가정하여 집어넣는다. 그리고 이 분포는 각각의 공액쌍 ( conjugate pair ) 이 어느정도 존재한다. 해당 공액쌍은 각각의 확률 분포 함수와 호환이 잘되며 결과값도 같은 형태로 나와 Posterior -> Prior 로 손쉽게 순환 및 개선 구조를 자연스럽게 가져간다.

| 예시 | 확률 | 사전 분포 | 비고 |

| 고객 구매 여부 | Bernoulli | Beta | 클릭률, 전환율 |

| 로그인 수 | Poisson | Gamma | 방문 수 예측 |

| 광고 클릭 수 (분산 큼) | Negative Binomial | Gamma 등 | 과분산 |

| 고객 이탈 시간 | Weibull | 없음 (non-conjugate) | 생존 분석(MCMC) |

| 상품 A/B 테스트 | Binomial | Beta | 성공/실패 수 |

conjugate는 '결합,연결' 정도의 의미이며 여기서는 개인적으로 짝궁 같은 느낌이다. 더 정확히 말하면 곱해도 같은 분포 모양이 유지될 때 공액쌍이라고 한다.

특별한 도메인 데이터가 추가되면 MCMC로 구해야겠지만 ( 일회성 대규모 마케팅, 요일별 마케팅, 정기 패치 등 ) 일반적인 상황에서는 해당 공액쌍은 꽤나 유효하고, 베이지안의 목적 중 하나인 검증이나 추론, 설명가능성도 더 좋을 수 있다.

[실제 예시]

위에 잠시 언급한 포아송-감마 공액쌍 모델을 기반으로 신규 이커머스 사이트의 예시를 들어보자.

혹은 신규 서비스, 특정 페이지, 특정 세그먼트 등 데이터가 없으나 신뢰할만한 의사결정을 내려야할 때 모두를 포함할 수 있겠다.

개념 및 목적

사이트의 하루 평균 방문 수(λ)를 추정하고, 앞으로 며칠간의 트래픽을 예측

- 방문 수는 횟수(count)이므로 → 포아송 분포 사용

- 하지만 데이터가 부족하므로, λ를 고정된 값이 아닌 '분포'로 생각해야 함 → 베이지안 접근

- 이때 포아송의 conjugate prior는 → 감마(Gamma) 분포

빈도주의 방식

지금까지 5일간 총 방문자가 100명이었으면, 평균은 λ = 100 / 5 = 20

- λ는 20. 이후 모든 추정은 해당 감마를 기반으로 함.

- 불확실성에 대한 가정은 없으며, 그냥 20이 "진짜값"이라고 확신하고 계산.

5일 간의 방문자로 실제값을 '확신'한다는 것은 이미 현실적이지 않음

베이지안 방식 (Poisson likelihood + Gamma prior)

처음에 예상한 평균 방문자는 하루 15명 정도 (Prior)

그런데 5일간 실제 데이터를 보니 하루 평균 20명

→ 이 두 가지를 조합해서 λ에 대한 새로운 분포 (Posterior)를 만든다

- 예: Prior: Gamma(α=3, β=0.2) → 평균 15

- Observed: 5일간 총 방문자 수 100명 → Poisson likelihood로 반영

- Posterior는 여전히 Gamma 분포로 유지

| 항목 | 값 |

| α (Prior shape) | 3 |

| β (Prior rate) | 0.2 |

| ∑yi\sum y_i (총 방문자 수) | 100 |

| n (관측일 수) | 5 |

| α' (Posterior shape) | 3+100=1033 + 100 = 103 |

| β' (Posterior rate) | 0.2+5=5.20.2 + 5 = 5.2 |

최종 결과

| 항목 | 값 | 의미 |

| Posterior 평균 λ | 약 19.81 | 하루 예상 방문자 수 |

| 95% 신뢰구간 | 약 [16.4, 23.2] | 방문자 수의 분포 범위 ( Gamma의 분위수로 계산 ) |

| 분포 형태 | Gamma(103, 5.2) | 베이지안 분포적 추론 결과 |

[액션 시나리오]

결국 우리는 모델의 결과로 '점'이 아니라 하나의 '분포'를 얻었다.

정규분포처럼 해당 분포 안의 λ을 바꾸면서 새로운 수치에 대해 통계적으로 어느정도 값인지 판단할 수 있다.

1.리스크 기반 KPI 알림 기준 설정

"방문자 수가 너무 떨어지면 알람 보낼까? 어느 수치부터?"

- 베이지안:

"방문자 수가 15명 이하일 확률 = P(λ ≤ 15)를 Posterior에서 계산 → 2.3%"

→ 이 수치가 특정 임계치(예: 5%)보다 낮으면, '정상 범위'로 판단하고 알람을 안 보냄 - 빈도주의:평균 20으로만 판단 → 15는 그냥 ‘평균보다 낮은 수치’로만 해석됨 → 과민반응 가능

2.의사결정 신뢰도 기반 자동화

"지금 예산을 늘릴지 줄일지 자동으로 결정하고 싶어"

- 베이지안:

“λ ≥ 25일 확률은 0.8%” → 성장세가 아니다라는 판단 가능

“λ ≥ 21일 확률은 40%” → 성장 가능성은 있으나 애매

→ 투자 전략에 따른 자동 판단 조건 설정 가능 (e.g., 확률 80% 이상일 때만 증액) - 빈도주의:

평균 20이면 끝. 25가 클 뿐, 25일 가능성 자체에 대해선 말 못함

3. 불확실성 포함한 ROI 예측 및 의사결정

“1명당 수익이 1,000원일 때, 하루 방문 수 기반 일매출 추정은?”

- 베이지안:

λ ~ Gamma(103, 5.2)이므로,

→ 수익도 분포를 따름 (1,000 × λ)

→ 95% 신뢰구간: 16,400 ~ 23,200원

→ 이를 기반으로 보수적 시나리오(하한) 기반 마케팅 기획 가능 - 빈도주의:

20명 × 1,000원 = 20,000원 → 단일 추정치만 나옴

→ worst-case, best-case 대응 전략이 불가능

4. 고객 군집별 불확실성 기반 분리 전략

“유저 A는 평균 20명 오는데, 유저 B는 평균 20명이지만 분산이 큼. 어떤 유저가 위험?”

- 베이지안:

- A: Gamma(100, 5) → 신뢰구간 좁음 → 안정적

- B: Gamma(10, 0.5) → 신뢰구간 넓음 → 불확실성 큼 → 모니터링 필요

→ 두 유저의 λ는 같지만, 신뢰도 차이로 인한 마케팅 분리 전략 수립 가능

- 빈도주의:

평균 20 → 둘 다 동일 취급 → 분리 불가

5.최적 타이밍 결정

“내일 캠페인을 집행할지 말지 정해야 함. 불확실성이 너무 클 땐 보류하고 싶음.”

- 베이지안:

내일 예측 방문자 수가 18명 이상일 확률 = P(λ ≥ 18) = 78%

→ 지금 캠페인 진행 시 충분한 효과가 있을 확률은 78%

→ 경계선 넘지 않으면 다음날로 유예 - 빈도주의:

λ = 20 → 그냥 “괜찮을 것 같아” 수준. 신뢰구간 없음 → 정량적 판단 불가

기본적으로 현재 ML 생태계는 대부분 빈도주의 알고리즘 기반으로 구성되어 있기 때문에 베이지안이 필요한 경우가 바로 떠오르지 않을 수 있다. 관련하여 아래와 같이 다시 정리해본다.

베이지안은 '내 데이터를 의심 하는 것' 에서 출발한다.

따라서 Prior의 개념이 있고, 완벽한 point형 데이터를 인입하는 대신 distribution을 인입한다.

또한 결과도 distribution의 형태로 받는다. 즉 '분포로 표현된 확신 정도'로 나온다.

1. 데이터가 적고 불확실성이 높은 상태에서 결정을 내려야 할 때

- 평균만 보고 판단하면 리스크가 큼

- 결과의 불확실성까지 수치로 보고 싶을 때

2. “분산이 중요”한 문제를 다룰 때

- A 캠페인: 클릭률 평균 20%, 신뢰구간 [15%, 25%]

- B 캠페인: 클릭률 평균 20%, 신뢰구간 [5%, 40%]

점추정은 둘을 같다고 봄 , 베이지안은 A를 더 안정적이라고 판단

3. 의사결정이 “확률 기반”일 때

- 점추정은 “50% 넘으면 OK”

- 베이지안은 “이 유저가 80% 확률로 이탈할 거다”까지 말해줌

'Data Analysis' 카테고리의 다른 글

| 베이지안 ( Bayesian ) 은 왜 필요할까 (0) | 2025.06.18 |

|---|---|

| A/B 테스트 - DA를 넘어 사회과학 분야의 꽃 ( p-value / Bayesian ) (0) | 2025.05.05 |

| Funnel 분석이란 ? (0) | 2025.05.04 |

| 코호트(Cohort) 분석이란? (0) | 2025.05.02 |

| AARRR 이란 ? (0) | 2025.05.02 |